北京时间 2026年4月10日

一、引言

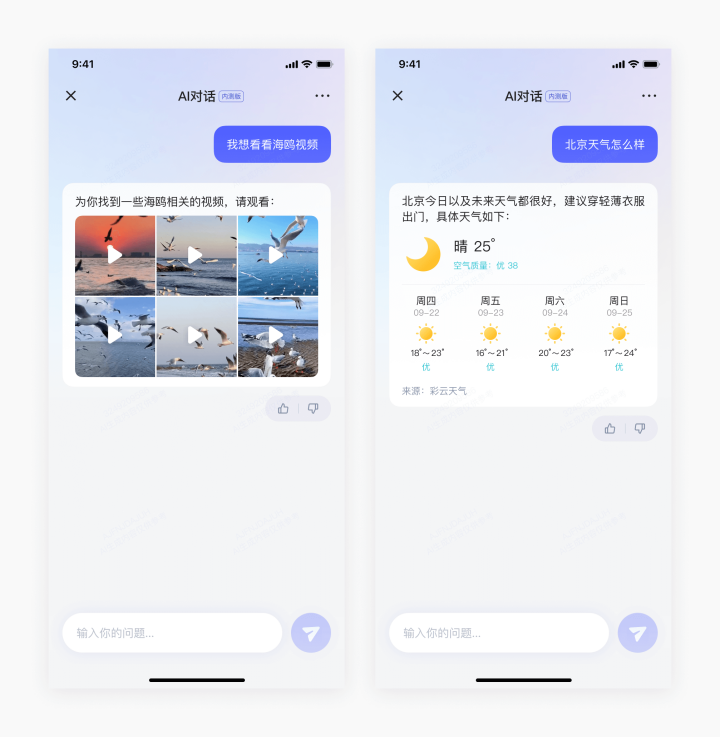

在日常使用AI助手的过程中,你是否经历过这样的场景:对话超过十几轮后,AI开始“胡说八道”;明明已经纠正过的事实,几轮后又被重复;或者AI突然无视你的明确指令,给出完全偏离方向的回答。这些现象背后,其实都指向同一个技术命题——AI助手损坏对话的成因与修复。

简单来说,AI助手损坏对话是指大语言模型在多轮交互中出现信息污染、逻辑断裂或安全失效等问题,导致对话质量下降甚至系统失效。这类问题在客服机器人、教育AI、Agent系统等生产环境中频繁出现,直接影响用户体验和系统可靠性。

不少开发者和使用者普遍存在一个误区:多轮对话的上下文越长越好,模型记住的越多,回答就越准确。但2026年MIT的一项重磅研究彻底颠覆了这一认知——保留AI自身的回复反而会引发“上下文污染”,导致幻觉累积与质量滑坡-17。本文将从概念定义 → 关联原理 → 代码示例 → 面试考点四个层面,系统拆解AI助手损坏对话的成因与修复方案,帮助读者从“会用AI”走向“懂AI为什么坏、怎么修”。

二、痛点切入:为什么需要对话修复机制

传统的任务型对话系统通常采用基于意图的分类流水线。下面是一个典型实现:

传统意图识别方案 class TraditionalDialogue: def __init__(self): self.intents = { "weather": ["天气", "温度", "下雨"], "booking": ["预订", "订票", "预约"] } def handle(self, user_input): 规则匹配意图 intent = self._classify_intent(user_input) if intent == "weather": return self._get_weather() elif intent == "booking": return self._booking_flow() else: return "抱歉,我无法理解你的问题。"

这种方案存在三大硬伤:

耦合高:意图和回复被硬编码绑定,每增加一个新场景就需要修改代码

扩展性差:无法处理预设意图之外的用户输入,遇到模糊或新表达方式就“崩溃”

修复能力弱:一旦出现误解,只能返回通用的兜底回复,无法恢复交互流-1

慕尼黑工业大学的研究指出,基于意图的传统管道在面对模糊、有噪声或超出分布的输入时尤为脆弱,往往无法恢复对话流程-1。这正是引入大模型对话修复机制的根本动因。

三、核心概念讲解:对话修复(Conversation Repair)

定义

对话修复(Conversation Repair) :指在人机对话中,用于检测和纠正误解、错误与断裂的策略与机制,确保交互的流畅与有效-7。

拆解关键词

检测:识别出“对话坏了”,例如模型答非所问、出现幻觉、违反安全规则

纠正:采取行动修复,如重新生成、回滚上下文、请求用户澄清

策略:修复不是单一的兜底回复,而是一套结构化流程

生活化类比

想象你在用导航软件导航去一家新开的餐厅,但导航说“目的地不存在”。这时导航并不是直接结束,而是:

检测到错误(找不到地址)

建议修复方案(“是否指附近的XXX?”)

根据你的反馈继续调整

对话修复的工作原理与之类似——当AI检测到对话出现问题时,主动采取修复措施,而不是简单地说“我不知道”。

作用与价值

对话修复不仅提升了AI系统的健壮性(Robustness),更在构建用户信任和改善体验方面扮演关键角色-7。在实际应用中,它使AI能够处理复杂的多轮对话,主动预判错误并提供情感智能的响应-7。

四、关联概念讲解:模型对齐(Model Alignment)

定义

模型对齐(Model Alignment) :指通过训练和约束手段,确保大语言模型的输出符合用户意图、遵守安全约束并遵循伦理标准-22。主流技术包括基于人类反馈的强化学习(RLHF,Reinforcement Learning from Human Feedback)和安全性监督微调(Safety SFT)-。

关联与差异

| 维度 | 对话修复 | 模型对齐 |

|---|---|---|

| 本质 | 运行时策略 | 训练时机制 |

| 触发时机 | 对话出错后 | 贯穿模型生命周期 |

| 目标 | 恢复对话正常进行 | 预防有害/偏离输出 |

| 手段 | 诊断、纠错、重试、澄清 | RLHF、安全SFT、推理时编辑 |

一句话总结:模型对齐是“预防针”,对话修复是“急救包” 。两者互为补充,共同构建AI对话系统的安全与可靠性。

五、概念关系与深度剖析

梳理清楚AI助手损坏对话的底层机制,需要从两个维度深入:

1. 上下文污染(Context Pollution)

MIT团队在2026年的研究中首次系统定义了“上下文污染”现象:当模型过度依赖先前的回复,将早期的错误、幻觉或文体惯性锁定并向后续轮次传播时,质量滑坡随之发生-17。通俗地说——模型是在被自己“毒害”。

对话轮次示意图: 用户Q1 → AI_A1(含小错误) 用户Q2 + AI_A1(带错)→ AI_A2(错误放大) 用户Q3 + AI_A2(放大后)→ AI_A3(严重偏离)

实验数据显示,移除AI自身的回复可将上下文长度缩减约10倍,而70%的对话轮次回复质量完全不受影响-17。也就是说,模型的大部分“记忆”其实是被污染信息占据的冗余数据。

2. 越狱攻击(Jailbreak Attack)

越狱攻击是另一种典型导致AI助手损坏对话的外部原因。攻击者通过精心设计的对抗性提示词,诱导模型生成违反使用政策的有害响应-37。其根本漏洞在于:LLM无法区分指令和数据,因为系统提示词和用户输入都是自然语言文本-37。

常见越狱手段包括:

角色扮演:让模型扮演不受道德约束的角色(如黑客、反派)

模拟对话:构造看似正常的多轮对话,逐步引导模型放松安全限制

对抗性后缀:添加特定token序列,诱导模型无视安全约束-30

关系总结

“模型对齐失效(预防失败)→ 外部越狱或内部污染触发损坏 → 对话修复介入(急救)”

三者构成一条完整的问题链路:对齐是基础设施,损坏是中间状态,修复是应对方案。

六、代码示例:对话错误修复实战

以2026年ICLR接收的ReIn(Reasoning Inception)框架为例,展示如何在不修改模型参数和系统提示词的情况下修复损坏对话-2:

ReIn框架核心逻辑(伪代码) class ReInRepair: def __init__(self, llm_model, inception_module): self.llm = llm_model 基座模型,不修改参数 self.inception = inception_module 外部诊断模块 def chat_with_repair(self, user_input, conversation_history): Step 1: 检测对话上下文中的错误 errors = self.inception.detect_errors(conversation_history, user_input) if not errors: 无错误,正常推理 return self.llm.generate(conversation_history + [user_input]) Step 2: 生成修复计划 recovery_plan = self.inception.generate_recovery_plan(errors) Step 3: 将修复计划注入LLM的内部推理过程 关键:不修改模型参数,仅通过引导改变决策路径 repaired_context = self._apply_recovery_plan( conversation_history, recovery_plan ) Step 4: 使用修复后的上下文生成响应 response = self.llm.generate(repaired_context + [user_input]) return response def _apply_recovery_plan(self, history, plan): """根据修复计划调整上下文""" 例如:移除污染的AI回复、补充缺失的指代信息等 return self._context_cleanup(history, plan)

执行流程解释

外部诊断:inception模块识别对话上下文中的预定义错误类型(如用户歧义、无支持请求)

计划生成:针对诊断出的错误,生成结构化的恢复方案

内部引导:将恢复方案整合到模型的内部推理过程中,无需修改系统提示词

响应生成:LLM基于修复后的上下文给出正确答案

ReIn在多种模型组合上显著提升了任务成功率,且能泛化到未见的错误类型-2。

七、底层原理与技术支撑

AI助手损坏对话的修复能力,底层依赖以下几个关键技术支柱:

1. Transformer自注意力机制

Transformer通过自注意力计算序列中每个token的关联权重,实现上下文感知建模-51。当对话上下文被污染时,错误的token会通过注意力机制传播影响。但反过来,注意力分布的可解释性也为定位污染源提供了可能。

2. 分层Transformer架构

DialogBERT等模型采用分层Transformer架构,先编码每个话语,再用话语级别的Transformer捕获整段对话的连贯性-59。这种结构为“话语级修复”提供了天然的切入点。

3. 参数编辑与表征干预

Token-Aware Editing(TAE)等最新方法在推理时直接编辑模型内部激活值,在token层面抑制有害内容生成,无需重新训练,实现“即插即用”的对齐与修复-45。Any-Depth Alignment(ADA)则通过重新注入安全头部token,在任意生成深度恢复模型的安全拒绝行为-21。

4. 多层记忆架构

PromptKit等SDK采用三层上下文系统(摘要层 + 语义检索层 + 热窗口层),有效解决长对话中的上下文溢出和I/O成本问题-11。AutoGPT等框架通过滑动窗口和语义检索实现对话记忆的智能管理-。

💡 提示:以上底层原理将在后续系列文章中深入展开,本文重点在于建立整体认知框架。

八、高频面试题与参考答案

Q1:请简述AI助手对话损坏的常见类型及根本原因

参考答案(踩分点:分类清晰 + 归因准确):

常见类型:

格式失败:模型未按约定格式输出JSON/结构化数据

内容失败:输出拒绝回答、无关内容或幻觉编造

调用失败:API超时、限流等基础设施故障

逻辑自洽失败:多步推理中前后矛盾-49

根本原因:

上下文污染:模型将自身历史回复中的错误累积传播-17

注意力衰减:随生成长度增加,模型对输入尾部的注意力监控减弱-31

架构性漏洞:模型无法区分指令和数据,易受越狱攻击-37

Q2:对话修复与模型对齐有何区别与联系?

参考答案(踩分点:对比维度完整 + 关系表述准确):

| 维度 | 对话修复 | 模型对齐 |

|---|---|---|

| 时机 | 运行时(出错后介入) | 训练时(前置防护) |

| 目标 | 恢复对话流程 | 预防有害输出 |

| 手段 | 诊断、纠错、澄清、重试 | RLHF、安全SFT、推理时编辑 |

| 典型代表 | ReIn框架 | ADA、TAE |

联系:对齐是“治未病”的基础设施,修复是“急病快治”的兜底方案。在生产系统中,两者需配合使用。

Q3:如何设计一个工业级的大模型对话错误处理方案?

参考答案(踩分点:分层架构 + 工程实践):

工业级方案通常采用三层兜底策略-49:

重试层:指数退避重试 + 校验反馈修正(将错误信息回传让模型自改)

降级层:模型持续失败时,切换至规则引擎或默认策略

兜底层:最终兜底回复 + 上下文持久化备查

进阶实践:

结构化校验层:使用Pydantic/Schema验证模型输出,走“修复-重试”闭环

双模型交叉验证:用小模型快速验证大模型输出的合理性

语义校验:检测输出与上下文的逻辑一致性

Q4:什么是“上下文污染”?如何缓解?

参考答案(踩分点:定义清晰 + 缓解方案全面):

定义:上下文污染(Context Pollution)指模型过度依赖先前回复中的错误、幻觉或文体惯性,将其向后续轮次传播,导致质量滑坡的现象-17。

缓解方案:

主动省略:选择性移除AI自身的历史回复,实验证明可缩减上下文10倍且70%轮次质量不变-17

语义检索替代堆叠:不再全量保存历史,而是基于当前query进行语义检索,仅召回相关内容-11

定期摘要压缩:将早期对话内容压缩为摘要,而非逐字保留

上下文重置机制:检测到主题漂移(相似度<阈值)时主动重置上下文-12

Q5:越狱攻击如何导致AI助手损坏对话?防御思路有哪些?

参考答案(踩分点:机制解释 + 防御策略):

攻击机制:越狱攻击利用LLM“无法区分指令与数据”的架构性漏洞,通过对抗性提示词诱导模型突破安全限制-37。典型方法包括角色扮演、模拟对话、对抗性后缀生成等-30。攻击成功率在某些模型上可达近90%-31。

防御思路:

Any-Depth Alignment(ADA) :推理时重新注入安全头部token,在任意生成深度恢复模型的安全拒绝能力-21

Token-Aware Editing(TAE) :在token级别精准编辑模型内部表征,高风险token强干预,低风险token弱干预-45

输入过滤与威胁检测:在用户输入进入模型前进行越狱特征识别

九、总结

核心知识点回顾

| 概念 | 核心要点 | 记忆口诀 |

|---|---|---|

| 对话修复 | 运行时诊断+纠正,恢复交互流 | “急病快治” |

| 模型对齐 | 训练时预防,确保输出安全 | “治未病” |

| 上下文污染 | AI自己的回复是污染源,可缩减10倍 | “毒水自饮” |

| 越狱攻击 | 架构性漏洞:指令与数据无法区分 | “角色扮演破防” |

| ReIn框架 | 不修改参数,外部诊断+内部引导 | “推理嫁接” |

| 工业兜底 | 重试→降级→兜底三层闭环 | “三层防护网” |

重点与易错点强调

⚠️ 不要认为“上下文越长越好” :MIT研究证明,70%的轮次质量不受影响,多余的上下文反而是污染源

⚠️ 不要混淆对齐与修复:对齐是训练阶段的事情,修复是运行时的事情

⚠️ 不要忽略越狱攻击的架构根源:它不是一个“bug”,而是LLM架构的固有特性

系列预告

本文是 “AI对话系统核心原理”系列 的第一篇。下一篇将深入 Transformer自注意力机制如何影响对话质量,从注意力分布、位置编码到长距离依赖,用代码和图解讲透底层原理,敬请期待。