讲真的,说到那个“AI助手声明”,我以前是真的从来不看。就跟装软件时狂点“下一步”一样,刷一下就给勾选了,恨不得拿秒表计时。结果呢,直到有一次差点吃了大亏,我才老老实实坐下来,花了几分钟去瞅了一眼那个又臭又长的文档。

这件事还要从我被一群95后“卷”到开始说起。上周公司开会,一个新来的实习生妹子因为了解AI助手声明里的相关权责条款,在甲方质疑数据归属的时候,直接把文件截图甩了过去,保住了整个项目的著作权。我当时站在旁边,表面风平浪静,心里早就翻江倒海了——卧槽,原来那个我从来懒得看的玩意儿,关键时候能值几万块钱?

所以今天我就想跟你掏心窝子地聊聊,为什么你用了这么久的AI助手,如果真的不想当冤大头,就千万别再“勾一下就拉倒”了。

平时用AI处理工作,你是不是也有这种感觉?用着挺爽的,但是心里总有点发毛。特别是当你把公司商业计划书、客户资料或者自己的创意文案喂给AI之后,你有没有想过一个问题——这些数据会跑到哪里去?是不是隔天竞争对手就会用上你绞尽脑汁想出来的点子?

别急,咱们来扒一扒用户协议里那些藏在犄角旮旯的猫腻。

先说最让人头疼的“隐私大坑”。你是不是觉得,既然AI免费给你用,你付出点数据也理所应当?错!你看中国青年报社社会调查中心做过一个调查,使用AI工具时,超八成(83.6%)的受访青年都担心个人隐私安全问题-28。这不是杞人忧天,权限较高的AI智能体应用能直接深入到你的手机底层权限里,一旦被授权,有些应用甚至能捕获屏幕显示的所有信息,读取社交聊天、支付明细,模拟你操作完成订阅付费-。

有人可能会说,AI助手声明里不是写了会保护隐私吗?但实际情况是,大量用户吐槽AI智能体应用的数据处理就像一个“黑箱”,你根本不知道它在后台拿你的信息干了什么-29。更别提有些“侵入式AI”了,它们还会打着无障碍功能的幌子来突破权限,说白了就是一种“打擦边球”的操作-。

除了数据安全,另一个大雷就是知识产权的归属。这事说大不大,说小不小,但一旦出问题就能让你难受好一阵子。比如你让AI写一篇爆款文章,或者生成一套PPT,那这篇东西的版权到底算谁的?是算你的,还是算AI提供商的?

市面上不同的AI助手声明差距还挺大的。有些平台虽然写着“权利归用户”,但在细节里给你挖了很多坑。比如有的平台明确写了“有权采取技术手段或人工手段对用户使用服务的行为及信息进行审查”-。更夸张的是,一些AI助手App的用户协议里被爆出存在“霸王条款”,专家都呼吁要重视了-。还有的智能体平台通过协议构建了一道“责任防火墙”,把你和AI开发者之间的风险隔离开来,万一出事了,平台说自己只是中立的技术提供者,概不负责-。

那咱普通用户总不能因噎废食,从此不用AI吧?这肯定不现实,毕竟现在的AI助手确实是生产力加速器。所以咱们得掌握技巧,怎么读、怎么防、怎么用,才能既享受AI的便利,又不被坑。

第一,别再当一个无脑的“签字机器”了。下一次当你打开任何AI助手,弹出那个冗长的用户协议时,别急着滑到底部点“同意”。花五分钟扫一遍,重点看两个部分:数据使用条款和责任归属条款。看看平台有没有说会把你喂给它的内容拿去训练模型,如果写了,那你就得斟酌一下了。

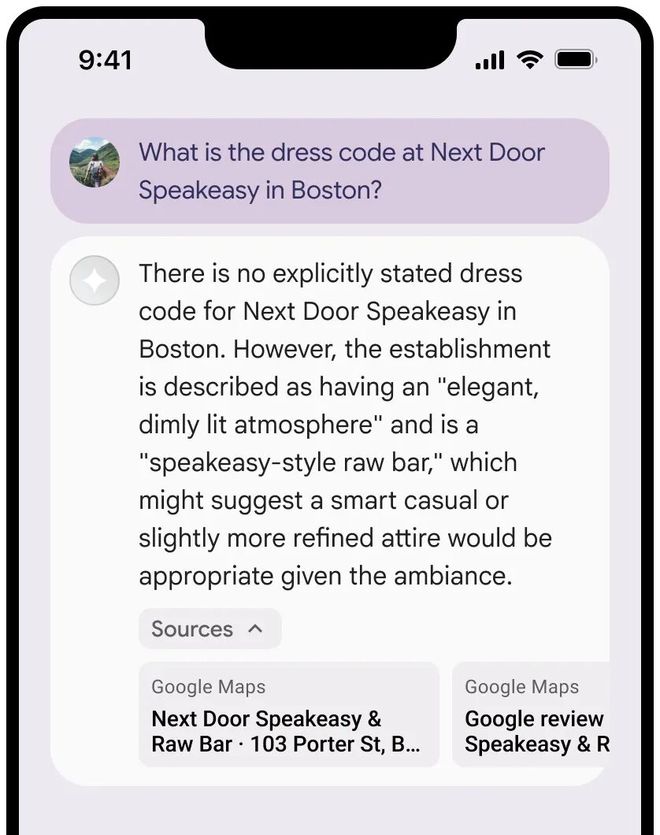

第二,学会区分“AI助手声明”和日常免责提示。就像前段时间微软调整了Microsoft 365 Copilot的免责声明,默认隐藏了聊天窗口底部“AI生成的内容可能不准确”的提示-1。官方说法是为了减少视觉干扰,但咱们自己心里得有数——该有的警觉一点都不能少。根据我国最新出台的《人工智能生成合成内容标识办法》,像文本这类生成内容,平台必须在起始、末尾或者中间适当位置添加文字提示标识-57。所以下次看到这类标识,别当它是废话,那可是你的“护身符”。

第三,保持清醒的“人脑纠错”意识。前几天我一个同事用AI分析合同,结果对方把“违约金”翻译成了“违约罚款”,差点在法律上吃哑巴亏-22。还有兰州有位张先生更绝,散落了一串金珠手串想请AI帮忙数一下,结果AI给出来的数字比实际数量多了一倍,最后还得自己一颗一颗数-22。AI再强,说到底是个概率模型,不是神仙。

第四,主动行使你的权利。很多用户协议里写着你有权申诉、有权删除个人数据。如果你发现AI的回答有明显偏差或者触及了隐私底线,一定要利用平台提供的反馈机制。比如中国科学技术大学AI助手的用户协议里就特别提醒,未满18周岁的未成年人需要法定监护人陪同阅读,并在完全理解的情况下才能使用服务-。你在点赞、点踩、投诉举报的时候,平台会收集你的反馈数据用于后续改进模型-10——这就是你在行使权利,也是在帮你后面的用户踩坑。

第五,关注行业标准的变化。现在电信终端产业协会已经发布了《生成式人工智能产品和服务用户权益保护要求》系列标准,专门针对用户数据处理提出了规范要求,涉及数据收集、传输、存储、使用和输出等全链条-67。这意味着整个行业正在往正规化方向走,但咱们用户自己也得跟上节奏,别等被坑了才想起来维权。

总的来说,在AI这条高速路上,想跑得快,又想不翻车,就得先把路标看清楚。那个你之前忽略的“AI助手声明”,其实就是你驶入AI世界的交通法规。

把上面这些话听进去,明天你在和客户、老板讨论项目时,底气绝对会硬气三分。

—— — — — — — — — — — —

网友提问一:

“我平时就是拿AI写写公众号推文,感觉用着挺顺手的啊,有没有必要去专门研究那些枯燥的法律条款?”

答:

这个问题问得很实在。如果只是纯粹自己写着玩玩,发在朋友圈或者自娱自乐,说实话,风险确实不大。但一旦你想靠它吃饭——比如做自媒体接广告、写商业文案卖钱,那情况就完全不一样了。

举个简单例子,你用AI写了一篇阅读量十万+的爆款文章,这篇文章如果被别人抄袭了,你能维权吗?这取决于你在AI助手声明里有没有保留“权利”。有些平台的条款可能写的是“生成内容的知识产权归平台所有”,那就相当于你给平台当了免费劳动力,辛辛苦苦构思出来的创意,结果版权不是你的。

再比如,万一AI生成的内容涉及侵权了——它抄袭了某本书的原话或者侵犯了别人的肖像权,这个锅谁背?是算在AI头上还是算在你头上?目前法律对于这个问题还在不断完善中,但有一点可以肯定:AI不具备法律主体资格,责任最终还是会落到用户或者服务提供者头上-。

所以我的建议是,哪怕你不是法律专业出身,至少也得知道怎么在用户协议里找到关键的几条条款。现在很多平台的协议已经把重点条款加粗标出来了,专门给你提示-。花十分钟看一看,总比将来万一出事了花几个月去处理要划算得多。

网友提问二:

“我就怕隐私泄露,AI会不会把我聊天的内容偷走拿去卖钱?”

答:

哈哈,这个问题一看就是被各种隐私泄露新闻吓怕了。实话告诉你,这种担心真不叫多虑,因为确实有风险。

中国青年报的调查数据摆在那儿,超八成的年轻人都跟你一样有这种顾虑-28。尤其是一些权限较高的AI智能体,能直接读取你手机里的大多数应用信息。有专家就指出过,一旦这类应用被授权,它就能捕获屏幕显示的所有内容,从社交聊天到支付明细,甚至能模拟你本人完成订阅付费等敏感操作-。

不过,话说回来,主流的大厂商在合规这块抓得还是比较严的。根据我国目前的法律框架,AI平台在收集你的信息时,有明确的告知义务-28。简单来说,就是它得明明白白告诉你“我要收你的什么数据、拿来干什么、存多久”。你不能接受,可以拒绝;就算接受了,将来后悔了,也可以要求删除。

给你三个实操建议:第一,在AI助手声明里重点关注“数据收集”和“数据使用”条款,看看平台有没有说明你的数据会不会被拿去训练模型-;第二,别下载来路不明的“野鸡”AI工具,尤其是那种非官方渠道的小众应用;第三,定期在账户设置里清理历史对话记录,不给平台留“存货”的机会。

AI就像一把双刃剑,用好了提高效率,用不好就等着被反噬。但只要你心里有这根弦,提前做好防范,基本不用太担心。

网友提问三:

“公司不允许我们把内部数据喂给AI,但是又想用AI来帮我们写工作总结、整理会议纪要,有没有两全其美的办法?”

答:

这个问题特别专业,也特别现实。很多企业的法务和IT部门现在都在头疼这个事,因为一方面AI确实能提升效率,另一方面数据安全又是企业的生命线。

根据目前的法律法规,企业在使用AI助手时,有义务以透明的方式通知最终用户,包括提供关于人工智能服务限制和功能的明确免责声明-。翻译成人话就是:公司用AI帮你们处理内部数据之前,得告诉你们是怎么个用法,用了之后会有什么后果。

对于你的困扰,我帮你梳理出三条比较可行的路:

第一条,选择企业级AI产品。个人版的AI助手大多没有签企业保密协议,数据安全确实无法保障。但现在很多大厂都推出了企业版或者私有化部署版本,签了专门的数据保护协议,在法律层面上有保障。

第二条,对输入数据进行脱敏处理。如果公司预算有限用不起企业版,那就学会“打码”。比如你要让AI帮忙分析一段客户对话,可以把客户的名字、电话号码、具体金额这些敏感信息换成张三、李四或者123456这样的代号,只保留对话的逻辑框架让AI帮你梳理。

第三条,关注行业标准里“最小必要原则” 。现在AI行业有明确规定,数据调用必须遵循“最小化、临时性”原则,高敏感操作必须交还用户本人确认-。也就是说,AI要拿你的数据,只能拿解决当前问题“够用”的那部分,不能狮子大开口。

说到这我想起一个反面案例,有一家公司的员工为了图省事,把公司的核心报价单直接粘贴给了个人版AI助手,结果那个AI平台后来更新条款,暗示可能会把用户输入的数据用于优化模型。虽然最后没有爆出实质性的泄露事件,但这个员工当天就被公司解聘了。

所以在AI使用这件事上,咱们既要会吃AI的“红利”,又要学会在AI助手声明的框架内打好“太极拳”。在边界之内使劲薅羊毛,在边界之外果断踩刹车。