开篇引入

SVC(Singing Voice Conversion,歌声转换)是当前AI音频生成领域的高频技术方向。许多人对“AI孙燕姿”翻唱现象耳熟能详,但其背后真正扮演核心角色的技术正是SVC——而SVC助手AI唱歌这一工具链的开源实现,让普通开发者也能将任意歌声转换为目标音色。学习者在接触这项技术时,常面临三大痛点:只会套用预训练模型生成效果,却不理解其技术原理;将SVC与TTS、VC等概念混为一谈;面试中被问到SoftVC与VITS的关系时答不出底层逻辑。本文将从技术痛点切入,逐步拆解SVC的核心概念、架构关系、实战流程和面试考点,助你构建完整的知识链路。

一、痛点切入:为什么需要SVC技术?

传统方法实现“声音迁移”,大多依赖音高平移或简单的频谱映射,比如通过声码器直接替换音色特征。以下是一个极为简化的频谱映射伪代码示例:

def traditional_voice_conversion(source_audio, target_spectrum): 提取源音频的频谱 source_spec = extract_mel_spectrogram(source_audio) 简单替换为目标音色频谱(错误做法) converted_spec = target_spectrum (source_spec / source_spec.mean()) 合成音频 return vocoder_synthesize(converted_spec)

这种方式的缺陷十分明显:音色与内容特征高度耦合,导致转换结果带有明显机械感;情感表达丢失严重,歌声音高起伏和节奏细节被粗暴抹平;扩展性极差,每换一个目标音色都需要重新构建映射表,维护成本高。

SVC技术的出现正是为了解决上述痛点——它将“内容”与“音色”解耦,允许你在保留原歌声音高、旋律、情感的基础上,独立替换音色,从而让“AI孙燕姿”既能唱出原歌手的每一个转音,又拥有孙燕姿的声线特质。

二、核心概念讲解:SVC(歌声转换)

SVC(Singing Voice Conversion,歌声转换) 是一种在不改变旋律、节奏和歌词的前提下,将源歌唱音频的音色特征转换为目标歌手音色的AI技术-1。它与传统TTS(Text-to-Speech,文本转语音)有着本质区别:TTS以文本为输入,输出合成的语音;而SVC以音频为输入,输出音色迁移后的音频,即“音频→音频”的转换-2。

生活化类比:如果把一首歌比作一幅画,内容就是画中的构图、线条和故事(即旋律、音高、歌词),音色则是画家的笔触风格和用色习惯(即声音的“质感”)。传统方法相当于用橡皮擦掉原画家的笔触后重新涂抹,画面往往变得模糊失真;而SVC相当于保留构图和线条,只更换绘画工具——从水彩换成油画——从而让新作品既有原作的灵魂,又呈现全新的视觉风格。

作用与价值:SVC让音乐创作不再受限于演唱者的天赋条件,普通人的歌声可实时转换为专业歌手音质-1;同时为虚拟偶像、游戏角色配音、多语种歌曲翻唱等场景提供了高效创作工具-1。

三、关联概念讲解:SoftVC与VITS

SoftVC(Soft Content Encoder,软内容编码器) 是一种从原始音频中直接提取与说话人无关的内容特征的神经网络模块。与传统的硬编码方式不同,SoftVC能够在不依赖文本中间表示的前提下,精准捕获音频的语音内容、音高信息和情感细节-11。

VITS(Variational Inference with Text-to-Speech,变分推理文本转语音) 是一种基于条件变分自编码器和对抗学习的端到端语音合成架构。在SVC领域,VITS将传统TTS的文本输入替换为SoftVC提取的内容特征,从而实现了端到端的歌声转换-11。

VITS与SoftVC的关系:SoftVC是 “听觉器官” ,负责从源音频中“听出”并提取内容特征(即保留了旋律、歌词但不带音色的“声音DNA”);VITS是 “发声器官” ,负责将提取出的内容特征与目标音色信息进行融合,生成新的声学特征,最终由声码器合成音频波形。二者是分工协作的关系,缺一不可。

四、概念关系与区别总结

清晰理解以下三组核心关系,是掌握SVC技术的关键:

| 对比维度 | SVC | TTS | VC |

|---|---|---|---|

| 输入类型 | 音频 | 文本 | 音频 |

| 输出内容 | 音色迁移后的歌唱音频 | 合成语音 | 音色迁移后的语音 |

| 保留特征 | 旋律、音高、情感、节奏 | 无 | 语音内容 |

| 核心应用 | AI翻唱、虚拟歌手 | 语音助手、有声读物 | 语音匿名化、配音 |

一句话记忆:TTS是“无中生有”(文本→语音),SVC是“移花接木”(音色替换,保留旋律),VC是“换脸不换表情”(音色替换,保留语音内容)。

在架构层面,SoftVC与VITS的关系同样可以凝练为一句话:SoftVC负责从源音频中“提取内容DNA”,VITS负责将DNA与目标音色“融合表达” ——前者是“分析”能力,后者是“合成”能力,二者共同构成了so-vits-svc的核心技术骨架。

五、代码/流程示例演示

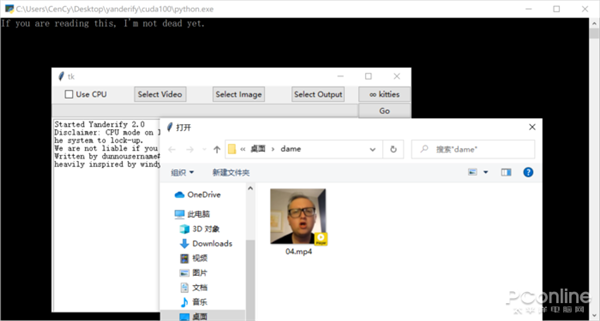

以下是一个基于so-vits-svc框架的完整歌声转换流程,涵盖环境配置、数据预处理、训练和推理四个核心步骤。所有代码均基于Python 3.8+环境运行。

环境准备

克隆项目仓库 git clone https://gitcode.com/gh_mirrors/sov/so-vits-svc cd so-vits-svc 安装依赖(推荐使用清华镜像加速) pip install -i https://pypi.tuna.tsinghua.edu.cn/simple -r requirements.txt

数据预处理

将干声音频按以下目录结构组织(建议10分钟以上无伴奏清唱,采样率44.1kHz)-1:

dataset_raw/ └── {speaker_name}/ └── .wav

运行预处理脚本提取Hubert特征和F0音高信息:

python preprocess_hubert_f0.py --dataset_path dataset_raw模型训练

训练主模型(音色转换核心) python train.py -c configs/config.json -m 44k 训练浅扩散模型(提升音质,可选) python train_diff.py -c configs/diffusion.yaml

对于6GB显存的GPU,推荐将batch_size设置为6-3。

推理转换

python inference_main.py -m "logs/44k/G_10000.pth" \ -c "configs/config.json" \ -n "input.wav" \ -s "target_speaker"

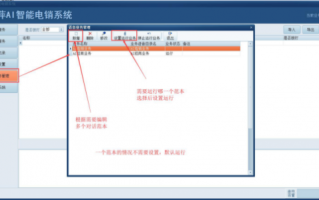

或者通过可视化界面一键操作-1:

python webUI.py新旧方案对比:传统频谱映射方案需手动配置映射表,转换一条30秒音频耗时约5秒,且音色与内容特征耦合严重;SVC方案通过端到端的深度神经网络,训练完成后推理仅需约0.5秒,且能完整保留原歌声的情感和音高细节。

六、底层原理/技术支撑

SVC技术的底层依赖以下关键知识点:

内容编码器:基于HuBERT、Whisper等自监督预训练模型,将原始音频映射为内容特征向量。so-vits-svc主要采用ContentVec作为默认编码器(取Transformer第12层输出),其本质是对音频信号的深层语义表征-11。

F0音高提取:通过CREPE、Dio、FCPE等算法从音频中提取基频信息(Fundamental Frequency),确保转换后的歌声保持原有的音高曲线和旋律走向-1。

声码器(Vocoder) :将声学特征(如Mel频谱图)还原为可听音频波形。so-vits-svc采用NSF HiFiGAN作为声码器,有效解决了传统模型的声音中断和机械感问题-2。

浅层扩散模型(Shallow Diffusion) :在声码器生成之前,对Mel频谱图进行逐步去噪优化,显著提升音质表现-2。

底层逻辑:SVC技术的核心是特征解耦——将一段歌声中混杂的“内容特征”(说了什么、怎么唱的)与“音色特征”(谁在唱)分离开来。只有成功解耦,才能做到“换音色不换内容”。这一目标的实现依赖于深度神经网络的自监督学习和对抗训练机制,而VITS架构中的条件变分自编码器正是实现这一解耦的关键数学工具。

七、高频面试题与参考答案

Q1:请解释SVC与TTS的核心区别。

参考答案:SVC(Singing Voice Conversion)输入是音频,输出是音色迁移后的歌唱音频,保留原歌声的旋律、音高和情感;TTS(Text-to-Speech)输入是文本,输出是合成语音,不保留任何原始演唱特征。简单来说,SVC是“音频→音频”的转换,TTS是“文本→音频”的合成-1。

Q2:so-vits-svc的核心技术架构是什么?

参考答案:so-vits-svc的核心架构由三部分组成:①SoftVC内容编码器,从源音频中提取与说话人无关的内容特征;②VITS变分自编码器,将内容特征与目标音色信息融合;③NSF HiFiGAN声码器,将声学特征还原为音频波形-1。整体上采用端到端设计,避免了传统方法中的中间步骤信息损失。

Q3:什么是特征解耦?为什么它对SVC很重要?

参考答案:特征解耦是指将一段歌声中相互交织的“内容信息”(旋律、歌词、音高)与“音色信息”(说话人身份、声线特质)分离开来。在SVC中,解耦是实现“换音色不换内容”的前提条件——只有成功解耦,才能在保留原歌声音高和情感的同时,独立替换目标音色。so-vits-svc通过SoftVC编码器和VITS架构实现了这一解耦-14。

Q4:浅层扩散模型在SVC中起什么作用?

参考答案:浅层扩散模型在声码器合成之前,对生成的Mel频谱图进行逐步去噪和优化,从而消除音频中的杂音、断层和机械感。这一机制让转换后的歌声更自然、更富表现力,显著提升了最终音质-2。

结尾总结

回顾全文核心知识点:

SVC(Singing Voice Conversion) 是歌声转换技术,能在保留旋律的前提下替换音色,区别于TTS(文本→语音)和VC(语音→语音)。

SoftVC与VITS的关系:SoftVC负责“听”和提取内容特征,VITS负责“说”和融合目标音色,二者共同构成so-vits-svc的技术骨架。

核心流程:数据预处理 → 特征提取(Hubert + F0) → 主模型训练 → 浅扩散模型训练 → 推理转换。

底层依赖:自监督内容编码器、F0音高提取算法、HiFiGAN声码器、浅层扩散模型,核心技术是“特征解耦”。

易错提醒:不要混淆SVC与TTS;训练数据必须是无伴奏干声,时长建议10分钟以上;注意训练数据集的版权授权问题,否则AI生成内容可能面临侵权风险-27。

下篇文章将深入探讨SVC的实时推理优化,从模型轻量化(ONNX导出、INT8量化)到推理加速(TensorRT集成),助你将SVC助手AI唱歌技术落地到更高效的生产环境中,敬请期待。