关键词:搜狗AI评价助手 | 技术科普+原理讲解+代码示例+面试要点 | 目标读者:技术入门/进阶学习者、在校学生、面试备考者、相关技术栈开发工程师

一、基础信息配置

| 项目 | 内容 |

|---|---|

| 文章标题 | 搜狗AI评价助手技术解析:2026大模型评价生成原理与面试要点 |

| 发布时间 | 北京时间 2026年4月10日 |

| 目标读者 | 技术入门/进阶学习者、在校学生、面试备考者、相关技术栈开发工程师 |

| 文章定位 | 技术科普 + 原理讲解 + 代码示例 + 面试要点 |

| 写作风格 | 条理清晰、由浅入深、语言通俗、重点突出 |

二、开篇引入

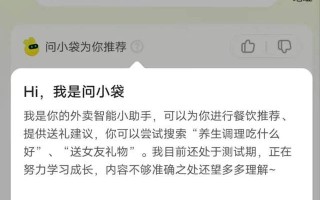

在AI技术飞速发展的2026年,智能写作辅助工具已成为互联网产品的标配能力。从电商购物评价到外卖点评,从微博评论到朋友圈文案——AI自动生成评价内容正以前所未有的速度渗透到用户的日常表达场景中。而在这场智能写作变革中,搜狗AI评价助手作为集成在搜狗输入法中的核心AI能力,凭借其跨应用、跨终端、高频调用的独特优势,正在重新定义“智能输入”的边界-5。

许多开发者对这类AI辅助写作工具的理解仍停留在“会用”层面:知道它能生成评论,却不清楚背后的技术原理;了解它的功能,却说不清大模型是如何理解用户意图、如何生成多样化文案的。这种“只知其一不知其二”的状态,正是技术面试中的常见扣分点。

本文将带领读者从用户需求痛点出发,深入拆解搜狗AI评价助手的核心技术架构、工作原理与底层支撑,并提供可运行的简化代码示例与高频面试题解析。通过本文,你将建立从“输入关键词”到“生成评价”的完整技术认知链路。

三、痛点切入:为什么需要AI评价助手?

3.1 传统写评价的痛点

在搜狗AI评价助手推出之前,用户在电商平台、外卖平台、社交媒体上撰写评价,往往面临以下困境:

(1)文案灵感枯竭——吃完外卖想说点什么,却对着评价框发呆,甚至连15个字的评价要求都凑不够-19。

(2)表达风格单一——只会写“还不错”“挺好的”,缺乏生动多样的表达方式。

(3)多场景适应困难——给五星好评需要一套话术,吐槽差评又需要另一套表达,用户难以快速切换语气和风格。

3.2 旧有实现方式

在传统实现中,如果要让系统自动生成评价文案,通常的做法是模板匹配:

传统模板匹配式评价生成(伪代码示例) def generate_review_old(keyword): templates = { "衣服": "这件衣服质量很好,做工精细,尺码标准,穿着很舒服。", "外卖": "味道不错,配送速度快,下次还会再点。", "服务": "客服态度很好,耐心解答了我的问题。" } return templates.get(keyword, "体验还不错")

3.3 传统方式的缺陷

这种基于固定模板的实现存在明显问题:

❌ 缺乏灵活性:对关键词的变体(如“这件衣服真不错”)无法识别和响应

❌ 风格单一:每种场景只有一种固定表达,无法生成“彩虹屁”式赞美或“段子手”式吐槽

❌ 无法语境感知:不能根据用户已输入的内容智能联想和续写

❌ 无法个性化:所有人的评价文案千篇一律

3.4 新技术的设计初衷

搜狗AI评价助手正是为了解决上述痛点而设计。其核心思路是:用大语言模型替代硬编码模板,通过深度学习理解用户输入语义,动态生成多样化、符合语境的评价内容-3。搜狗输入法在2020年首次推出AI购物评价助手时,就能在用户输入少量评价关键词后智能联想生成完整的评价句子,并且支持一键切换为另一句不同的评价内容-3。

四、核心概念讲解:大语言模型(LLM)

4.1 定义

LLM(Large Language Model,大语言模型) 是一种基于深度学习的大规模自然语言处理模型,通常基于Transformer架构。它通过在海量文本数据上进行训练,学习语言的语义、语法和上下文关系,从而具备理解人类语言并生成连贯文本的能力-。

4.2 拆解关键词

| 关键词 | 含义解读 |

|---|---|

| “大” | 参数规模巨大(数十亿到数万亿),海量训练数据 |

| “语言” | 专注于自然语言的理解与生成 |

| “模型” | 通过深度学习训练得到的数学函数,可将输入映射为输出 |

4.3 生活化类比

想象一个读了整个互联网的学霸:他读过数以亿计的书籍、文章、评论、聊天记录-。当你在他的耳边说“写个五星好评”,他立刻就能调动脑中海量的知识,模仿人类用户的表达习惯,写出一段自然流畅的文案。这就是大语言模型的核心能力——通过学习海量语料,掌握人类语言的规律,再根据新的输入生成合理的输出。

4.4 在搜狗AI评价助手中的作用

大语言模型是搜狗AI评价助手的“大脑”-,承担以下核心职责:

理解用户意图:将用户输入的“哈哈”“好帅”“衣服不错”等自然语言,转化为模型可计算的语义向量

推理与关联:根据输入内容,关联相关语境(如输入“好帅”识别为追星场景,生成彩虹屁文案-3)

生成多样化输出:基于概率分布,生成风格各异、符合语境的评价文本

五、关联概念讲解:搜狗AI评价助手的核心技术栈

5.1 定义

搜狗AI评价助手的核心技术栈包括三个层次:

① NLP(Natural Language Processing,自然语言处理) ——理解用户输入文本的语义、情感和上下文关系-

② 个性化词库系统——搜狗积累的海量用户词库和细胞词库,为模型提供个性化素材-

③ 轻量化LLM推理引擎——基于Transformer架构的大语言模型的精简版,在端侧或云端实现实时推理-

5.2 概念关系:LLM vs NLP vs 个性化词库

| 概念 | 角色定位 | 类比 |

|---|---|---|

| NLP | 底层技术能力 | 语言的“语法书” |

| LLM | 核心模型引擎 | 大脑本身 |

| 个性化词库 | 数据输入来源 | 大脑的“记忆库” |

三者关系:NLP提供了技术方法论,LLM是具体实现载体,个性化词库是数据支撑来源。搜狗AI评价助手正是这三者的有机结合——LLM负责理解与生成,NLP提供语义处理基础,个性化词库让生成的内容更贴合用户表达习惯-。

5.3 运行机制示例

以用户输入“好帅”为例,搜狗AI评论助手的工作流程如下-3:

用户输入 → NLP语义分析(识别追星语境)→ LLM生成(基于训练数据中的“彩虹屁”语料) → 个性化词库匹配(结合用户常用表达)→ 输出候选文案

输出结果示例:

“好帅,你干干净净没有故事,一个帅字贯穿一生!”

“好帅,你是干净的,像春天的风一样。”

六、概念关系与区别总结

| 对比维度 | LLM(大语言模型) | 传统模板匹配 |

|---|---|---|

| 实现方式 | 深度学习、概率生成 | 固定字符串匹配 |

| 灵活度 | 高,可生成无限变体 | 低,输出内容固定 |

| 语境感知 | 能理解上下文 | 无法感知语境 |

| 可扩展性 | 新场景无需重新编码 | 每增加一个关键词就要新增模板 |

| 资源消耗 | 计算成本高 | 几乎零成本 |

一句话概括:LLM是“教会AI写评论”,模板匹配是“给AI一个评论库让它复制粘贴”。

七、代码/流程示例演示

以下是一个极简化的大模型评价生成示例(模拟搜狗AI评价助手的核心逻辑):

模拟搜狗AI评价助手的文本生成核心逻辑 实际生产环境中基于千亿级参数的大语言模型,此处为教学演示 import random class SimpleReviewGenerator: """简化版评价生成器 - 模拟大模型生成机制的核心思路""" def __init__(self): 模拟模型从海量语料中学习的风格特征向量 self.style_library = { "positive": ["很棒", "满意", "推荐", "物超所值", "五星好评"], "negative": ["失望", "一般", "不值", "体验差", "不推荐"], "humorous": ["绝了", "yyds", "上头", "真香", "入股不亏"], "professional": ["做工精细", "设计合理", "性价比高", "品质可靠"] } def understand_intent(self, user_input): """NLP语义理解:将用户输入映射为意图向量""" intent_scores = { "positive": 0, "negative": 0, "humorous": 0, "professional": 0 } 简化版关键词匹配(真实场景为深度语义向量计算) if any(word in user_input for word in ["好", "赞", "喜欢", "满意"]): intent_scores["positive"] += 1 if any(word in user_input for word in ["搞笑", "有趣", "吐槽"]): intent_scores["humorous"] += 1 if any(word in user_input for word in ["质量", "细节", "设计"]): intent_scores["professional"] += 1 返回置信度最高的意图 return max(intent_scores, key=intent_scores.get) def generate_review(self, user_input, scene="通用"): """基于意图生成评价文本""" intent = self.understand_intent(user_input) Step 1: 风格采样(模拟大模型的自回归生成过程) base_style = random.choice(self.style_library[intent]) Step 2: 场景适配(模拟上下文感知) if scene == "外卖": output = f"外卖{base_style},{user_input}的感觉。" + ( "配送快,包装好,下次还会回购!" if intent == "positive" else "希望下次能改进。") elif scene == "电商": output = f"商品{base_style},{user_input}。物流给力,购物体验不错。" else: 社交评论 output = f"{base_style}!{user_input},绝绝子!" Step 3: 多样化候选(模拟多候选返回) candidates = [ output, output.replace("!", "~").replace("绝绝子", "太可了"), f"{base_style} +1,{user_input}的体验很真实。" ] return candidates 使用示例 generator = SimpleReviewGenerator() print(generator.generate_review("衣服质量真好", scene="电商")) 输出示例: ['商品很棒,衣服质量真好。物流给力,购物体验不错。', ...]

代码关键点说明:

语义理解:

understand_intent()模拟NLP层的意图识别(真实场景基于深度语义向量)风格采样:从风格特征库中采样,模拟大模型的自回归生成

场景适配:根据应用场景(外卖/电商/社交)调整输出模板

多样化候选:同一输入返回多个不同风格的文案,用户可一键切换-3

八、底层原理/技术支撑

搜狗AI评价助手的底层技术支撑主要包含以下三个层面:

8.1 技术架构全景

搜狗输入法的AI能力架构经历了从“词库匹配”到“生成式预测”的底层逻辑演变-。当前的搜狗AI评价助手基于以下技术栈:

8.2 核心技术模块详解

(1)Transformer架构与大语言模型(LLM)

搜狗输入法后台采用基于Transformer架构的大型语言模型,支持轻量化部署以实现端侧或云端实时推理-

自注意力机制(Self-Attention) 是该架构的核心创新,让模型在生成每个词时,能够自动关注输入文本中与当前词相关的其他词,从而更好地理解上下文关系-

(2)自然语言处理(NLP)与语义理解

NLP引擎负责意图识别和情感分析,能够区分用户是想点赞、吐槽还是单纯提问

搜狗技术团队在CLUE中文语言理解评测中曾多次获得冠军,展示了其在自然语义理解领域的技术实力-

(3)个性化词库与用户画像

每个用户都有专属的用户词库,其中存储的字词能够体现用户的个性化表达习惯-

搜狗输入法通过分析用户的打字习惯、常用词汇、表达风格,构建用户画像,让生成的内容更贴合用户个人风格

8.3 生成式AI的核心机制

AI评价助手的文本生成遵循“概率预测”原理:当给定一个输入序列(提示词),模型会分析上下文并计算下一个token的概率分布,通过重复选择最有可能的后续token来生成完整文本-。

生成过程可以理解为:

输入 → 编码器(理解语义)→ 解码器(逐词生成)→ 输出 ↑ ↑ 自注意力机制 概率采样+束

九、高频面试题与参考答案

面试题 1:请简述搜狗AI评价助手背后的核心技术原理。

参考答案:

搜狗AI评价助手的核心技术基于大语言模型(LLM) 和自然语言处理(NLP) 。用户输入关键词后,NLP引擎进行语义理解和意图识别,确定用户的表达意图(赞美、吐槽、提问等);然后LLM基于Transformer架构和自注意力机制,结合搜狗海量的语料库和用户个性化词库,通过自回归生成的方式逐词生成评价文本-3-。整个过程实现了从“词库匹配”到“生成式预测”的技术跃迁-。

踩分点:LLM + NLP + Transformer + 自注意力 + 个性化词库 + 自回归生成

面试题 2:大语言模型生成文本时,“自回归”是什么意思?为什么会影响生成速度?

参考答案:

自回归是指模型基于已生成的词逐步预测下一个词的过程。具体来说,模型首先根据输入生成第一个词,然后将该词作为新输入的一部分,生成第二个词,以此类推直到生成完整的文本-。

这种逐词生成的方式导致推理速度较慢,因为无法并行生成所有词——每一步都必须依赖上一步的输出结果。这也是为什么大规模部署LLM生成服务时,推理延迟和计算资源消耗是主要的性能瓶颈。

踩分点:逐词生成 + 串行依赖 + 延迟瓶颈

面试题 3:搜狗AI评价助手如何实现不同风格的文本生成(如彩虹屁vs吐槽)?

参考答案:

搜狗AI评价助手的风格多样性来源于三个方面的协同:

① 多样化训练数据:LLM在训练阶段学习了海量不同风格的文本,包括赞美类、吐槽类、段子类等语料,模型内部形成了对不同风格的“风格特征向量”;

② 意图识别与分类:NLP模块首先分析用户输入的情感倾向和语气,如输入“好帅”识别为追星赞美场景,输入“呵呵”识别为吐槽语境-3;

③ 条件生成(Conditional Generation) :模型在生成过程中引入风格标签作为条件约束,引导模型从对应的概率分布中进行采样,从而生成符合目标风格的文本。

踩分点:多样化训练数据 + 意图识别 + 条件生成

面试题 4:搜狗输入法从“词库匹配”演进到“生成式AI预测”,技术架构上发生了哪些变化?

参考答案:

这一演进本质上是从“规则驱动”到“模型驱动”的架构升级-:

| 对比维度 | 词库匹配时代 | 生成式AI时代 |

|---|---|---|

| 核心算法 | 词频统计 + 模板匹配 | 深度学习 + 大语言模型 |

| 输出方式 | 从预存词库中检索 | 动态生成新文本 |

| 灵活性 | 输出内容固定 | 可生成无限变体 |

| 资源消耗 | 轻量级 | 需要GPU算力支撑 |

技术架构上增加了LLM推理层和NLP语义理解层,云端部署了大量基于Transformer架构的轻量化模型来支持实时推理-。

踩分点:规则驱动 → 模型驱动 + 词库检索 → 动态生成 + Transformer + 云端推理

面试题 5:如果你来设计一个轻量级的AI评价生成服务,你会如何权衡“效果质量”和“推理延迟”?

参考答案:

我会采用多级缓存 + 模型蒸馏的策略:

① 模型蒸馏:用大模型(Teacher)蒸馏出小模型(Student),在保证一定效果的前提下大幅降低推理延迟;

② 热点缓存:对高频输入场景(如“好评”“味道不错”等常用关键词)的生成结果进行缓存,直接返回而无需实时推理;

③ 渐进式生成:首先生成简短的默认文案快速响应用户,后台异步生成更多高质量候选,用户可“加载更多”;

④ 端云协同:简单场景(如常用短语补全)在端侧用小模型处理,复杂场景(如长文本创作)再请求云端大模型。

踩分点:模型蒸馏 + 缓存策略 + 渐进式生成 + 端云协同

十、结尾总结

本文核心知识点回顾

| 模块 | 核心要点 |

|---|---|

| 痛点 | 传统模板匹配缺乏灵活性、无法语境感知、输出单一 |

| 核心概念 | LLM是大语言模型,基于Transformer架构,是AI评价助手的“大脑” |

| 技术栈 | NLP(语义理解)+ LLM(生成引擎)+ 个性化词库(数据来源) |

| 工作原理 | 用户输入 → NLP意图识别 → LLM条件生成 → 多样化候选输出 |

| 底层支撑 | 自注意力机制、自回归生成、Transformer架构、模型蒸馏 |

| 演进趋势 | 从词库匹配 → 生成式预测,从规则驱动 → 模型驱动 |

重点强调

搜狗AI评价助手的核心价值在于:将大语言模型的“理解-推理-生成”能力,无缝嵌入到高频调用的输入法场景中,让普通用户无需学习复杂提示词就能享受AI写作的便利-5。理解这一产品的技术本质,不仅有助于面试应答,更能帮助开发者建立起从用户需求到技术落地的完整认知链路。

后续预告

下一篇文章我们将深入探讨大语言模型的微调技术(Fine-tuning) ,讲解如何基于通用LLM训练出面向特定业务场景的垂直模型,包括LoRA(Low-Rank Adaptation,低秩适配) 等主流微调方法的原理与应用。

本文首发于2026年4月10日,文中涉及的搜狗AI评价助手功能基于截至发稿时的公开资料整理。