说真的,我这人以前挺抵触AI的。不是觉得它不好用,而是总觉得哪里怪怪的。你想想,每次你跟ChatGPT聊个天,说的每一句话、上传的每一份文件,全都得经过人家的服务器。要是问点跟公司业务相关的核心数据、或者自己写的私密代码,说实话,心里头真的有点儿发毛——就跟把家钥匙交到陌生人手上似的,踏实不了。

而且那些API调用的费用,七七八八加在一起,一个月下来还真不是小数目。前两天我那个做跨境电商的朋友老张就跟我吐槽,说他们公司光接大模型的接口,每个月账单就飙到了好几千块,关键业务量一上来,速度还卡得跟老牛拉破车一样。

直到后来有个在硅谷搞技术的哥们儿给我指了条路——他半开玩笑半认真地说:“你这智商税交得够冤的,创建自己的ai代理服务器又不难,自己搞一台放家里,想怎么用怎么用,数据全在你自己手上,不爽吗?”

我一听,还真是这么回事儿。于是我就开始了自己的折腾之路。中间踩过不少坑,也跑通过不少路,今天就把我这几个月摸爬滚打总结出来的经验,原原本本跟大家唠唠,希望能帮那些跟我一样想“自己当家做主”的朋友少走点弯路。

为啥非得自己搞一台?来来来,我给你算笔账

很多人不理解,说现在云端AI服务不是挺方便的吗?网页一打开就能用,干嘛非得自己折腾服务器?我就拿自己的经历跟你说。

第一是隐私问题。我写文章的时候经常会用到一些还没公开的商业案例、数据分析和内部资料,这些东西如果传到云端,万一泄露了,后果不堪设想。本地部署就不一样了,模型跑在你自己的机器上,文件存在你的硬盘里,AI读写数据全程不出你的局域网——谁也别想看你的底牌。

第二是成本问题。我刚开始也老老实实交API月费,后来算了一笔账才发现,一年下来足够买一台像样的主机了。自己搞服务器,一次性投入硬件,后续就只有电费——电费才几个钱?

第三是定制自由。云端模型就像一个黑箱子,你怎么调它它都只有那几招。自己部署就不一样了,想换模型就换模型,想调参就调参,甚至可以把多个模型组合起来用,打造一个完全听你话的AI系统。

第四是永远在线、从不掉链子。我有个朋友做自动交易脚本的,之前用云端API,三天两头因为网络波动或者对方服务器维护而中断,一中断就是真金白银的损失。后来他自己搞了服务器,本地跑着,稳得一批。

怎么开始?给你两条路,总有一条适合你

搞这个事儿吧,其实有两种路子。一种是零敲碎打自己攒,另一种是用现成的框架一步到位。我都试过,各有各的门道。

方案一:用Ollama+LangFlow,像搭积木一样搭建你的AI王国

这是我最先试的方案,也是最适合普通人的方案。Ollama是个什么东西呢?说白了就是个本地跑大模型的工具箱,你只需要在电脑上敲一行命令,就能把几百种开源模型下载下来,在自己的机器上跑起来。LangFlow呢,就像一个可视化的“乐高积木”,你拖拖拽拽就能把各种AI组件拼接到一起,完全不用写代码。

实操起来特别简单。先去Ollama官网下载安装包,装完之后在终端敲一行ollama run llama3.2,模型就开始下载运行了。等它跑起来之后,再装个LangFlow,把两者连上,你就可以像搭积木一样拖拽各种组件——想做个知识库问答机器人?拖个向量数据库组件。想做个能读CSV表格的AI助手?拖个数据加载器。全凭你心情。

我有一次做市场分析报告,需要让AI从几百页的行业报告中提取关键数据并生成图表。用LangFlow搭了个流程,Ollama本地跑着qwen2.5模型,不到十分钟就搞定了。这要是放以前人工做,至少得半天。

方案二:用OpenClaw,让AI真正替你“干活”

如果Ollama是让你跟AI“聊天”,那OpenClaw就是让你的AI真正“动手”。这玩意儿在2026年可谓是火爆全网,GitHub上星标已经飙到了250K,连英伟达的黄仁勋都亲自站台夸它。它最大的本事是什么呢?你可以让它去操作你的浏览器、读写你电脑上的文件、管理你的日程、甚至帮你订机票订酒店——全凭一句自然语言指令。

我邻居小王是做运营的,每天要处理上百条客户咨询,回复到手指抽筋。我帮他装了OpenClaw,对接了阿里云千问的免费API(新用户有免费额度,零成本就能用),然后把他的钉钉工作群接进去。现在客户发消息过来,AI自动根据知识库回复,解决不了的问题再转人工。小王说他的工作效率至少翻了三倍。

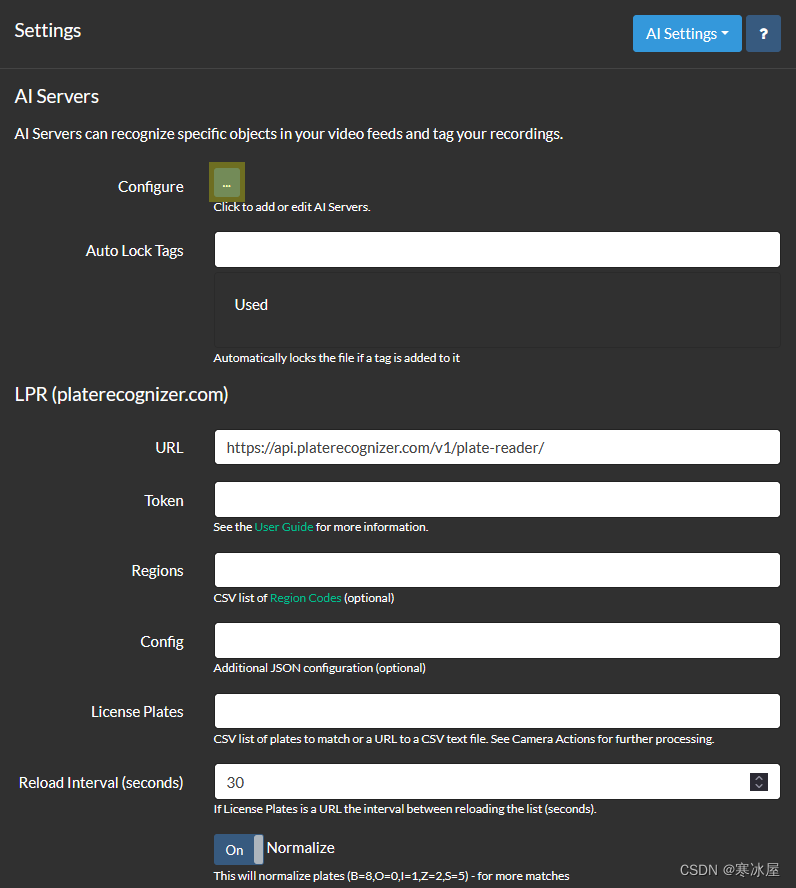

而且这玩意儿部署起来也没那么玄乎。阿里云上有现成的轻量服务器镜像,你只要买个2核4G的服务器(新用户有优惠券,几百块钱就能搞定),选OpenClaw的应用镜像,一键部署,5分钟就完事儿了。本地部署也支持Windows、Mac、Linux全平台,一台普通电脑就能跑。

用这种方式创建自己的ai代理服务器,你得到的不是一个只会聊天的玩具,而是一个真正能帮你干活的“数字劳动力”。更重要的是,所有数据都留在你自己的地盘上,不用担心隐私泄露。

别忘了这回事儿:安全比功能更重要

说了这么多好处,但我必须得跟你提个醒——AI代理这玩意儿,跑得快归跑得快,但安全这根弦一刻都不能松。

去年有个安全研究团队做了一个实验:他们在两个小时内就成功劫持了一个OpenClaw代理,也就是说,原本在帮主人处理工作的AI助手,突然被黑客控制了,开始执行恶意指令,而主人浑然不知。这还不是个例——安全公司Bitdefender的分析发现,大约有17%的OpenClaw技能包存在恶意行为,有些甚至能窃取加密货币。

所以啊,如果你要创建自己的ai代理服务器,一定记住这几个原则:

别把代理跑在你的主力电脑上。它应该待在隔离的环境里——要么是虚拟机,要么是云端独立服务器,要么是一台闲置的旧电脑。这样就算出了事,也不至于波及你的核心数据。

权限给到最小。AI能看哪些文件、能执行哪些操作,一定要设置明确的边界。别让它有超级管理员权限,不然就像把家里的大门钥匙给了陌生人。

做好审计日志。AI干了什么、什么时候干的、操作了什么文件,这些都要有记录。万一出了问题,也好追溯。

英伟达最近推出的NemoClaw就是专门解决这些安全问题的,它提供了沙箱隔离、最小权限控制和隐私路由等功能。有条件的话可以直接用,省心。

我踩过的坑,你就别踩了

最后说几个血的教训,希望能帮你省点时间和钱:

别一上来就想跑几百亿参数的大模型。很多人觉得模型越大越聪明,一上来就要跑DeepSeek 671B。结果显卡买了、服务器配了、钱花了几十万,发现推理速度慢得跟蜗牛一样,而且日常90%的任务根本用不到这么大的模型。从7B或13B的小模型开始,跑顺了再升级。

云服务器不一定比自建贵。我一开始也是自购硬件派的,觉得东西买回来是自己的,踏实。后来一算账才发现,中小规模的使用场景,租用云服务器反而更划算——不需要一次性投入几十万,不需要操心机房、电费和运维,按需付费,想升级就升级。你算算这个账再决定。

别忘了备份配置文件。我有个朋友折腾了整整一天才把OpenClaw调好,各种API配置、环境变量、权限设置全都配齐了。结果系统重装之后,啥都没了,只能从头再来。配置文件存到云端备份一下,也就多花一分钟。

大概就这些吧。搞AI代理这事儿,说难也不难,说简单也不简单,关键是想清楚自己要什么。如果你只是想尝个鲜、玩玩AI聊天,那用Ollama本地跑个小模型就够了。但如果你想让AI真正替你干点实事儿、解放双手,那就值得下点功夫自己搭一套完整的系统。别的不说,就冲那份“我的数据我做主”的踏实感,这事儿就值了。

以下来自网友的真实提问与交流——

网友“代码打工人”问:楼主你好,我是个独立开发者,平时用Cursor写代码,但云端API费用太高了,一个月大几百块。你说的Ollama方案真的能替代吗?我主要需要代码补全和bug修复,跑7B的模型够用吗?

答:你好啊朋友,你这问题问到我心坎里了。我当初也是被API账单逼得自己搞的。我跟你说,完全够用。我自己用的是Qwen2.5-Coder 7B这个模型,在Ollama上跑,日常的代码补全、函数实现、甚至简单项目的bug排查,基本都能搞定。推理速度嘛,在我那台RTX 3060的机器上,大概能到30-40 tokens每秒,打字快一点的时候能跟上。

但有几个细节你得注意:第一,模型量化很重要,建议用Q4_K_M或Q5_K_M的量化版本,显存占用小不少,性能损失也基本感觉不到。第二,如果你用的是VS Code,可以装Continue或者Cody插件,它们都支持连接本地Ollama服务。配置好了之后,体验跟用Cursor几乎一模一样,区别就是不用交钱了。

当然,跟顶尖的云模型比,本地模型在处理超长上下文和非常复杂的逻辑推理时,还是有一点差距的。但对于日常开发来说,我觉得已经够用了。你要是做特别复杂的项目,可以本地跑7B搞定大部分任务,偶尔遇到棘手的问题再去云端调一下大模型,这样成本也能控制得很好。

网友“企业IT小张”问:楼主好,我是公司IT部门的,老板想引入AI客服,但又担心数据安全,要求必须私有化部署。请问你推荐用哪个方案?预算大概5-10万左右。

答:小张你好,这个问题很有代表性。很多企业主都是这个心态——AI要上,但数据不能出去。我给你个实操方案。

预算5-10万,如果是中小企业,跑7B-13B级别的模型完全够用。硬件方面我建议这样配:双路至强服务器平台,内存128GB以上,显卡选两张Tesla T4 16GB(二手工包大概4800一块),总硬件成本控制在1.6万左右。这个配置跑通义千问35B的MoE模型,推理速度能到45 tokens每秒,非常稳。加上服务器主板、存储、机箱电源,全套下来3-5万。剩下的预算用来付电费和偶尔的运维。

软件层面,如果你想快速上线AI客服,推荐用OpenClaw部署在云服务器上(而不是本地机房,因为需要24小时在线)。阿里云轻量应用服务器,2核4G配置,选OpenClaw应用镜像,一键部署,5分钟搞定。再对接阿里云百炼的免费API(新用户有免费额度,够你测试一阵子),把钉钉或企业微信接进去,一个基础的AI客服系统就成型了。

如果你们需要更复杂的业务流程编排,比如AI调用内部CRM、自动建工单、查询库存等,那就再加一层LangFlow或者n8n,用拖拽的方式把各个系统串起来。

最关键的一点:把AI代理跑在隔离的虚拟机或者容器里,设置最小权限访问控制,所有操作留审计日志。这样就算出了什么问题,也不会波及核心业务系统。

网友“宝妈开网店”问:楼主你好,我自己开了个淘宝店,每天要回复很多买家咨询,还经常要处理退换货。听说AI能帮忙,但我完全不懂技术,能搞吗?

答:哎呀,这位姐妹,你这个需求太典型了。我帮你捋一下,放心,你完全能搞定,不需要会写代码。

淘宝客服这事儿,最麻烦的就是重复性问题——“什么时候发货”“尺码怎么选”“能退换吗”。这些完全可以交给AI。给你推荐一个门槛最低的方案:

去阿里云或者腾讯云注册个账号(新用户都有优惠,几百块钱能玩很久),在控制台里OpenClaw应用模板,选“AI智能体”一键部署。跟着向导走,选个最低配置(2核4G就够了),选个国内地域,点几下鼠标,大概5-10分钟就部署好了。然后你去阿里云百炼平台,注册个账号,拿到免费的API密钥,填进去。最后把你店铺绑定的钉钉群或者企微群接进去,设置一下——搞定。

以后买家发消息过来,AI会自动识别问题类型:退换货走退换货流程,尺码问题调用商品数据库查询,物流问题调取快递信息。解决不了的,再转人工。我认识的一个做服装店的老板,用了这套方案之后,客服工作量减少了将近70%,而且晚上她睡觉的时候,AI还能自动回复半夜咨询的海外客户。

完全不懂技术也别怕——现在的这些云服务商,都提供了图形化界面,点点鼠标就能完成。阿里云上甚至有零代码的一键部署方案,从零到上线,二十分钟就能搞定。你要是实在搞不定,花个几百块钱找个技术外包帮你搭一下,也是一次性的投入,后面全是省下来的时间和精力。