当前时间锚点:2026年6月WWDC大会前夕,macOS 27与新版Siri即将发布。

macOS平台上的AI助手正经历一场前所未有的范式转移。2026年1月,苹果宣布将Siri升级为系统级AI聊天机器人,内部代号“Campos”,计划随macOS 27正式亮相-5。与此同时,Anthropic向付费用户开放Claude的“电脑使用”(Computer Use)功能测试,AI能像真人一样操作鼠标、点击图标、编辑文件,甚至通过手机远程控制电脑-2。多数开发者对AI助手的使用仍停留在表层,只会简单调用API,却不理解背后的架构设计与运行原理。面试中被问到“Siri与ChatGPT的路由如何设计”时,答不出“端侧vs云端”的分发逻辑与优化策略,甚至混淆“Apple Intelligence”与“Siri”的概念边界。本文将从概念解析到底层原理,系统拆解macOS AI助手的技术栈,兼顾入门理解与面试备考。

一、基础信息配置

文章标题:macOS AI助手核心指南:从概念到原理与面试备考(2026年4月)

目标读者:技术入门/进阶学习者、在校学生、面试备考者、相关技术栈开发工程师

文章定位:技术科普 + 原理讲解 + 代码示例 + 面试要点,兼顾易懂性与实用性

写作风格:条理清晰、由浅入深、语言通俗、重点突出

二、痛点切入:为什么需要AI助手?传统方式的局限

在macOS AI助手尚未深度普及之前,开发者面临一个普遍困境:每个生产力需求都需要手动切换多个工具。想在编码时快速查询语法?打开浏览器→访问引擎→复制答案→切回编辑器。想让AI帮自己生成周报摘要?打开第三方聊天机器人网站→复制粘贴内容→等待返回结果→再粘贴回文档。这种操作不仅打断“心流”状态,更带来上下文切换的隐性成本。

传统方式:手动调用第三方API完成AI任务(低效、需要切换应用) import requests def ask_chatgpt(question): 打开浏览器 -> 登录 -> 复制粘贴 -> 手动复制结果 每次请求都有网络延迟,数据隐私也缺乏保障 response = requests.post( "https://api.openai.com/v1/chat/completions", headers={"Authorization": "Bearer YOUR_API_KEY"}, json={"model": "gpt-4", "messages": [{"role": "user", "content": question}]} ) return response.json()["choices"][0]["message"]["content"] 每次提问都需要切换应用,无法与本地文件、邮件等数据直接交互 print(ask_chatgpt("帮我总结这份PDF的内容"))

传统方式的痛点显而易见:耦合度高(每个AI能力需要单独集成)、扩展性差(新增AI功能需要重写调用逻辑)、维护困难(多端API版本同步复杂)、缺乏系统级上下文感知(无法读取当前窗口内容或文件系统)。这促使了系统级AI助手的诞生——将AI能力内置于操作系统底层,实现无缝调用与上下文感知。

三、核心概念讲解:Apple Intelligence

标准定义

Apple Intelligence(苹果智能,全称无独立缩写)是苹果公司在2024年6月发布的AI系统,它不是独立的应用程序,而是深度整合在iOS、iPadOS、macOS核心功能中的生成式AI能力体系-11。

概念拆解与类比

Apple Intelligence可以被理解为一个“分层冰箱”——不同温度分区存放不同保鲜需求的食材。简单查询(如写邮件润色、短信智能回复)由端侧模型(On-Device Processing)在本地完成,速度极快且不联网,保护隐私;复杂推理任务(如生成创意文章、图片总结)则由私有云计算(Private Cloud Compute)接力处理,任务完成后数据即刻删除,不留痕迹-12。

生活化类比:端侧模型像一个随身携带的口袋计算器,响应迅捷但能力有限;私有云计算则像拨打电话给远程专家,能解决复杂问题,但通话结束后“专家”不保留任何你的私人信息。

核心价值

Apple Intelligence的独特之处在于隐私优先的设计哲学——苹果坚持“端侧处理优先”原则,只有当本地算力不足以完成任务时,才会将请求发往私有云,且整个过程中用户的个人数据不会被保存或暴露给第三方-21。

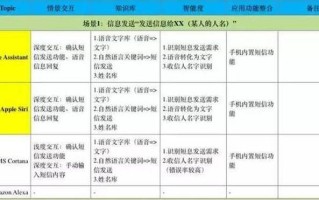

四、关联概念讲解:Siri(升级版)与Claude for Mac

Siri(升级版)定义

Siri是苹果的原生语音助手,诞生于2011年。2026年,苹果正在对Siri进行史上最大规模的改造,内部代号“Campo”,将其从传统语音助手转型为系统级AI智能体-1。新版Siri将支持:

语音与文本双模式对话式交流

访问用户备忘录、邮件、信息等个人数据

在应用内执行复杂任务(如跨App操作)

检索开放网络信息,支持“世界知识答案”功能-1-48

Claude for Mac定义

Claude是Anthropic公司开发的第三方AI模型。2026年3月,Anthropic以预览版形式向付费用户开放“电脑使用”(Computer Use)功能,让Claude可以直接控制用户的Mac电脑,像真人一样操作鼠标、点击图标、编辑文件-2。

概念关系与区别

| 维度 | Apple Intelligence | Siri(升级版) | Claude for Mac |

|---|---|---|---|

| 本质 | AI能力系统/平台 | 语音助手 + AI智能体 | 第三方AI模型 |

| 关系 | 底层基础能力 | 上层应用(入口) | 外部集成能力 |

| 运行方式 | 端侧+私有云混合 | 内置系统中 | 需付费订阅+网络调用 |

| 系统集成度 | 深度嵌入macOS | 原生内置 | 外部调用 |

一句话记忆:Apple Intelligence是“底座”,Siri是“话筒”,Claude是“外援”。

Apple Intelligence提供了AI能力的底层框架,Siri是用户与之交互的主要入口之一,而Claude则是通过ChatGPT集成入口调用的第三方模型能力。三者之间并非互斥,而是协同共存的关系。

运行机制示例

当用户在macOS中通过新版Siri提问“帮我总结今天收到的所有邮件,然后用友好语气写一封回复模板”,流程如下:

Siri识别多轮连续指令(“总结邮件”+“写回复模板”)-48

系统判断任务复杂度,简单指令由Apple Intelligence端侧模型处理

需要联网或复杂生成时,可通过第三方集成入口调用ChatGPT或Gemini模型-12

五、概念关系与区别总结

三个概念形成了清晰的层次结构:

Apple Intelligence:思想/框架——定义“AI应该以什么方式融入系统”

Siri:具体实现/入口——用户与AI能力交互的主要渠道

Claude/第三方模型:能力补充/外援——当原生能力不足时的外部资源

易混淆点提示:很多人误以为Siri就是Apple Intelligence的全部。实际上,Apple Intelligence还包括书写工具、视觉智能、Genmoji图片生成、实时翻译等多个模块,Siri只是其中一个交互入口-11。

六、代码/流程示例演示

macOS AI助手集成示例(基于Foundation Models框架)

Apple提供了Foundation Models框架,开发者可以通过该框架调用系统级大语言模型-。

// 简洁可运行的示例:在macOS应用中调用Apple Intelligence进行文本处理 import Foundation import FoundationModels // Apple Intelligence底层框架(macOS 26+) // 1. 创建AI模型实例(端侧优先) let model = try await FoundationModel.languageModel() // 2. 发送请求,系统自动路由(简单任务→端侧;复杂任务→私有云) let request = LanguageModelRequest( systemPrompt: "你是一个友好的Mac助手", userMessage: "帮我将下面这段话改写成正式语气:'Hey,别忘了周一下午三点开会'" ) // 3. 异步获取结果 for try await response in model.generate(request: request) { print("AI回复: \(response.text)") // 输出:'请您注意:周一下午三点将召开会议。' } // 4. 演示ChatGPT集成(用户授权后调用) if ChatGPTIntegration.isEnabled { let result = try await ChatGPT.shared.complete( prompt: "解释Swift中的可选类型", model: .gpt4 // GPT-4级别模型 ) print("外部模型结果: \(result.text)") }

关键步骤注解

| 步骤 | 说明 |

|---|---|

FoundationModel.languageModel() | 获取Apple Intelligence语言模型实例,端侧优先 |

LanguageModelRequest | 封装提示词,支持system prompt和user message分离 |

model.generate() | 异步生成,系统自动判断端侧/云端路由 |

ChatGPTIntegration | 用户授权的第三方集成入口,需在设置中手动开启- |

新旧实现对比

| 维度 | 旧方式(第三方API) | 新方式(系统级AI) |

|---|---|---|

| 调用方式 | 打开浏览器/独立App | 应用内直接调用 |

| 上下文感知 | 无(需手动复制粘贴) | 有(可读取当前窗口/文件/邮件) |

| 数据隐私 | 依赖第三方服务条款 | 端侧处理+私有云不留痕 |

| 响应延迟 | 网络请求,约500-2000ms | 端侧模型可达50-100ms |

| 系统集成 | 需要单独管理API密钥 | 原生内置,无需额外配置 |

七、底层原理与技术支撑

混合推理架构

macOS AI助手的核心技术支撑是端云混合架构(Hybrid Inference Model)。该架构通过一个本地分类器(Local Classifier)判断用户请求的复杂度,将简单任务分配给端侧模型,复杂任务路由至云端。

以MacPaw的Eney助手为例,其架构包括三层:

本地引擎:运行轻量化模型(如Llama-3.2-3B-Instruct微调版本),处理日历操作、文件操作、文本转换等简单任务,确保快速响应和数据隐私-20

云端后端:处理需要多步推理或外部API调用的复杂任务-20

上下文系统Mnemos:持续索引macOS环境(文件系统、邮件内容、日历等),为AI提供个性化的上下文信息-20

苹果端侧与云端模型技术架构

苹果在2025年公开的技术文档揭示了其AI底座的完整架构-21:

| 模型类型 | 参数量 | 运行环境 | 应用场景 |

|---|---|---|---|

| 端侧语言模型 | 约30亿参数 | Apple Silicon芯片(CoreML/Metal) | 书写工具、通知摘要、快捷指令 |

| 云端MoE大模型 | 1300-1800亿参数 | 私有云Apple Silicon集群 | 复杂推理、内容生成 |

| XCode代码模型(端侧) | 20-70亿参数 | Apple Silicon | Swift代码补全 |

| Swift Assist(云端) | 700亿+参数 | 私有云 | Copilot式编程辅助 |

| 图像扩散模型 | 驱动Genmoji | 端侧+云端混合 | AI图像生成 |

关键技术细节:

训练框架:基于TPU和Apple Silicon的AXLearn框架,完全不依赖NVIDIA硬件和CUDA-21

适配器技术:采用LoRA/DoRA动态加载微型适配器,每个仅10MB+,实现任务专项优化-21

量化压缩:3.5bit/权重的低位调色板化技术,实现5-6倍压缩率-21

推理优化:KV缓存减少重复计算,在iPhone 15上实现首token仅0.6ms的延迟-21

这一垂直整合策略使苹果能够避开GPU短缺问题,同时通过ML任务反哺硬件迭代。但代价是开发者需要适应全新的技术栈,短期内存在一定的学习成本-21。

八、高频面试题与参考答案

面试题1:Apple Intelligence的端侧与云端模型是如何协同工作的?

标准答案要点:

分类器机制:系统通过本地分类器判断任务复杂度,简单任务(<30亿参数模型可处理)→端侧,复杂推理任务→私有云

隐私保护:私有云计算采用“计算完即销毁”原则,个人数据不留存

路由策略:第三方模型(ChatGPT/Gemini)需用户明确授权后才会启用-67

延迟与成本权衡:端侧模型追求低延迟(50-100ms),云端模型追求高准确率,第三方模型用于补充能力边界

踩分点:分类器设计 + 隐私保护机制 + 路由策略 + 延迟/准确率/隐私三者的权衡考量。

面试题2:如何设计一个查询路由系统来区分Siri可处理的任务与需要GPT处理的任务?

标准答案要点:

任务分类维度:

设备控制类(设置闹钟、发送消息、控制App)→ Siri处理

开放生成类(创意写作、代码调试、复杂问答)→ GPT处理

个人数据类(查邮件/日历中的信息)→ Siri处理(端侧数据访问)

路由特征设计:

关键词检测(“设置”、“发送”、“打开”等动词→Siri)

语义相似度匹配(与已知设备指令库比较)

置信度阈值机制(低置信度时向用户澄清意图)

错误代价考量:将设备控制请求误路由到GPT会损害隐私和可靠性;将推理请求误路由到Siri会损害回答质量-67

踩分点:多维度任务分类 + 特征工程 + 置信度与容错机制 + 成本分析。

面试题3:LoRA/DoRA适配器技术在Apple Intelligence中的作用是什么?

标准答案要点:

定义:LoRA(Low-Rank Adaptation)是一种参数高效微调方法,通过在预训练模型中注入低秩矩阵实现任务专项优化

作用:Apple Intelligence通过动态加载微型适配器(每个仅10MB+),在不更换基础模型的情况下快速切换任务能力-21

典型场景:同时支持“邮件回复+友好语气”等多种风格适配器堆叠-21

优势:显著减少存储占用(相比完整微调节省99%以上),支持快速部署和A/B测试

踩分点:LoRA原理说明 + 体积优势 + 动态加载 + 多适配器组合。

面试题4:Apple Intelligence的隐私保护是如何从技术层面实现的?

标准答案要点:

端侧优先原则:尽量在本地完成计算,数据不离设备-21

私有云计算(Private Cloud Compute) :复杂任务发送到云端专用集群,但云端只接收加密的计算请求,不存储用户数据,任务完成后数据立即清除-12

差分隐私:在收集匿名化使用数据时注入噪声,无法反推出个体用户行为

用户授权机制:调用第三方模型(ChatGPT/Gemini)需每次明确授权-12

踩分点:四层隐私技术——端侧处理 + 私有云计算 + 差分隐私 + 授权机制。

面试题5:在macOS上部署本地AI模型(如Ollama + OpenClaw)需要哪些核心组件和硬件考量?

标准答案要点:

硬件要求:Apple Silicon芯片(M系列)优先,统一内存架构是关键,16GB内存可流畅运行70亿参数模型-43

核心工具链:

Ollama:本地LLM运行时,简化模型拉取和API服务-43

OpenClaw:AI智能体框架,支持工具调用和自动化任务-43

模型选型原则:Qwen 2.5-7B在M4芯片上可实现“秒回”级响应,对工具调用协议支持良好-43

隐私与成本优势:本地部署不依赖网络,数据不出本机,无需按Token付费-64

踩分点:硬件选型(Apple Silicon/统一内存)+ 软件栈(Ollama/OpenClaw)+ 模型平衡策略 + 本地化优势分析。

九、结尾总结

核心知识点回顾

macOS AI助手生态:Apple Intelligence提供底层能力框架(端侧3B + 云端MoE),Siri作为主要交互入口,Claude等第三方模型作为能力补充

端云混合架构:本地分类器决定路由方向,端侧模型追求低延迟与隐私,私有云计算保障复杂任务的安全处理

核心技术栈:LoRA适配器(10MB+动态加载)、量化压缩(5-6倍压缩率)、AXLearn训练框架(不依赖NVIDIA)

隐私设计:端侧优先 + 私有云计算 + 差分隐私 + 用户授权

重点与易错点提醒

| 重点 | 易错点 |

|---|---|

| Apple Intelligence是系统/平台,不是App | 误将Apple Intelligence当作独立应用 |

| 端侧模型约3B参数,云端MoE约130-180B | 混淆两类模型的参数量级和应用场景 |

| Siri是交互入口,不是AI能力的全部 | 将Siri等同于Apple Intelligence |

| 本地分类器决定任务路由方向 | 误认为所有请求都直接发送到云端 |

进阶内容预告

下一篇我们将深入探讨macOS AI助手的性能优化,包括:如何为Apple Silicon芯片定制模型量化策略、推理延迟的极致优化方案(KV缓存、令牌推测等),以及大型AI模型在端侧部署的内存管理技巧。敬请期待。

参考资料:

苹果AI战略重启:独立Siri应用曝光,WWDC 2026或迎全面升级. 知乎专栏. 2026-03-25-1

Mac新助理:Claude AI数字打工人全面接管电脑操作. PChome. 2026-03-24-2

对标ChatGPT与Gemini:苹果拟将Siri升级为公司首个系统级AI聊天机器人. IT之家. 2026-01-22-5

Apple Intelligence on Mac: Everything You Need to Know. Timing App. 2026-03-04-12

The Technology Powering MacPaw‘s AI Assistant – Eney. MacPaw. 2025-05-23-20

深度解析苹果端侧与云端基础模型技术架构. 腾讯云开发者社区. 2025-07-26-21

Design Siri-vs-GPT query routing – Apple Interview Question. 2026-01-04-67

Apple AI Engineer Interview Guide. Interview Query. 2026-02-09-68