当DeepSeek-R1、GPT-4o等大模型相继具备“动手能力”,你还在把AI助手和AI Agent混为一谈吗?

大模型技术发展至今,AI Agent(人工智能智能体,Artificial Intelligence Agent) 已成为2026年面试中最常被问及的概念之一-。许多开发者在日常工作中频繁使用ChatGPT、文心一言等AI助手,但当面试官问起“LLM和Agent有什么区别”时,往往语焉不详-。2026年4月,智源研究院发布的《2026十大AI技术趋势》明确指出:多智能体系统正成为决定应用上限的关键基础设施,Agent时代的“TCP/IP”已初具雏形-82。本文将用一个清晰的框架,带你理解AI Agent的核心概念、底层原理,并给出高频面试题的标准答案。

一、痛点切入:为什么我们不再满足于AI助手

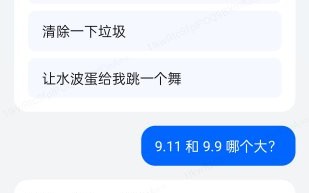

在理解AI Agent之前,先看一个常见场景:

传统方案:让AI助手帮忙“预订今晚7点、人均200元以下的日料餐厅”。助手会回复“我无法直接预订,建议您打开XX外卖App”——它只能提供建议,无法真正执行。

问题出在哪? AI助手本质上是“会说话的大脑”-。它能理解、能对话,但没有执行能力。遇到需要操作外部系统的任务,只能把皮球踢回给用户。

传统RAG(检索增强生成,Retrieval-Augmented Generation)虽然能查文档,但难以“记住”用户的偏好或历史决策细节-。大模型的知识库截止于训练日期,无法主动获取实时信息;缺乏与外部环境交互的能力,无法执行代码、调用API、抓取网页等具体任务-44。

正是这些局限,催生了AI Agent的设计初衷——让AI从“会说话”进化为“会做事”。

二、核心概念讲解:什么是 AI Agent

标准定义:AI Agent(人工智能智能体)是能够自主感知环境、规划任务、调用工具并执行行动的AI系统。它不是单一模型,而是一套“大模型+记忆+规划+工具”的组合架构-。

拆解关键词:

| 关键词 | 含义 |

|---|---|

| 自主感知 | Agent能主动接收环境输入,而非被动等待指令 |

| 规划任务 | 将复杂目标拆解为可执行的子步骤序列 |

| 调用工具 | 能够调用外部API、执行代码、操作数据库等 |

| 执行行动 | 在数字世界中真正“动手”完成操作 |

生活类比:如果把AI助手比作“餐厅里的点菜员”——你告诉它想吃什么,它帮你记下来、推荐菜品,但需要你自己吃。那么AI Agent更像“一位能做饭、会打扫的私人管家”——你只需要说“今晚招待三位朋友”,它会自主决定买什么菜、做多少分量、安排上菜顺序,全程无需你介入-。

核心特征:概括为四个关键词——自治性(Autonomy,无需人工干预独立运作)、工具性(Tool-use,调用外部能力执行任务)、反应性(Reactivity,对环境变化即时响应)和主动性(Pro-activeness,主动推进目标)-。

三、关联概念讲解:AI Agent vs AI助手

AI助手(AI Assistant)定义:使用AI辅助用户的工具,通常通过对话界面交互。它是被动响应式的,永远需要人类发起指令-32。

二者关系:AI助手是“会说话的大脑”,AI Agent是“配备了手脚的执行者”-。Agent是在助手能力基础上的能力进化,而非替代。

核心差异对比:

| 维度 | AI助手(Assistant) | AI Agent(Agent) |

|---|---|---|

| 运作模式 | 被动响应,等待指令 | 自主行动,主动推进 |

| 任务范围 | 单次问答或单步操作 | 多步工作流,持续执行 |

| 工具使用 | 依赖用户手动操作 | 自主调用API、工具、代码 |

| 决策方式 | 人做决策,AI提供建议 | Agent自主决策,人做监督 |

| 典型代表 | ChatGPT、文心一言、Siri | AutoGPT、Manus、DevOps Agent |

一句话概括:AI助手回答问题,AI Agent完成任务-。

四、概念关系总结

逻辑关系:AI Agent ≈ AI助手 + 规划能力 + 工具调用 + 记忆管理 + 自主执行

类比理解:

大脑 = 大模型(LLM,Large Language Model)

会说话的大脑 = AI助手

会动手的数字员工 = AI Agent-

记忆口诀:助手会回答,Agent会干活;助手等指令,Agent自己跑。

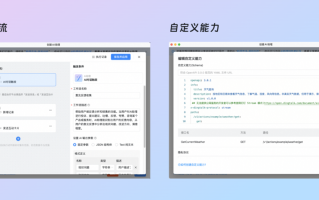

五、代码示例:20行代码构建极简AI Agent

以下代码演示了一个最简Agent的工作流程:

模拟一个简易的AI Agent:用户问天气 → Agent自主判断需要调用API → 执行 → 返回结果 import json 定义Agent可用的工具 TOOLS = { "get_weather": { "description": "查询指定城市的天气", "execute": lambda city: f"🌤️ {city}今日晴,24-32℃,建议穿短袖" }, "send_email": { "description": "发送邮件", "execute": lambda to, subject: f"✅ 邮件已发送至{to}" } } Agent核心循环:分析意图 → 选工具 → 执行 → 返回 def agent_loop(user_input: str): 1. LLM“思考”:判断需要哪个工具 真实场景中,这一步由大模型function calling完成 if "天气" in user_input: tool_name = "get_weather" params = {"city": "上海"} elif "邮件" in user_input: tool_name = "send_email" params = {"to": "boss@company.com", "subject": "周报"} else: return f"🤔 我是Agent,请告诉我需要做什么(查天气/发邮件)" 2. 调用工具执行 tool = TOOLS[tool_name] result = tool["execute"](params) 3. 返回执行结果 return result 测试 print(agent_loop("帮我查一下天气")) 🌤️ 上海今日晴,24-32℃ print(agent_loop("给老板发邮件")) ✅ 邮件已发送至boss@company.com

关键步骤解读:

| 步骤 | 说明 |

|---|---|

| 第1步:LLM推理 | 大模型分析用户意图,决定调用哪个工具、传什么参数 |

| 第2步:工具执行 | 系统执行预定义的外部函数(API调用、代码执行、数据库操作) |

| 第3步:结果回传 | 执行结果返回给模型,模型组织自然语言回复-44 |

真实场景中,上述代码中的意图判断由LLM的 Function Call(函数调用) 机制完成——模型以结构化JSON输出工具名称和参数,系统解析后执行-44。

六、底层原理与技术支撑

AI Agent并非凭空出现,它依赖以下底层技术:

Function Call(函数调用) :大模型以结构化格式输出工具调用指令,系统解析后执行-44。这是Agent“能做事”的基石。

ReAct框架(Reason + Act,推理+行动循环) :Agent在“推理→行动→观察→再推理”的循环中迭代逼近目标-1。

记忆管理:短期记忆存储当前会话状态,长期记忆使用向量数据库存储用户偏好,需要时检索回填-52。

工具抽象层:将API、数据库、代码执行器统一封装为Agent可调用的“工具”,标准化输入输出格式。

三层架构视角:应用层(业务逻辑)→ 编排层(任务规划与调度)→ 推理层(LLM决策) -61。这三层共同构成Agent系统的完整闭环。

七、高频面试题与参考答案

Q1:LLM和AI Agent有什么区别?

标准回答:LLM(Large Language Model,大型语言模型)是Agent的“大脑”,提供理解、推理和生成能力;但LLM本身不具备与外部环境交互的能力-44。AI Agent在LLM基础上增加了规划模块、记忆模块、工具调用模块,形成了完整的“感知→决策→行动”闭环,能够自主完成多步任务-。

踩分点:① 明确LLM是组件、Agent是系统;② 点出Agent的三个额外模块;③ 说明“感知-决策-行动”闭环。

Q2:ReAct和Plan-and-Execute两种Agent模式有什么区别?

标准回答:ReAct(Reason+Act) 采用“推理-行动-观察”循环,每步都看结果再决定下一步,灵活度高,适合用户需求动态变化的场景。Plan-and-Execute 先整体规划再批量执行,省token、效率高,但一旦中间出错不易恢复。生产实践中常混合使用:先做粗粒度计划,执行细节遇到异常时切到ReAct模式局部调整-52。

踩分点:① 分别解释两种模式的核心逻辑;② 对比优缺点;③ 给出混合使用的实践经验。

Q3:AI Agent如何保证工具调用不报错?

标准回答:三层保障机制。第一,结构化调用:优先使用模型原生的function calling,返回结构化JSON,直接解析-52。第二,格式校验与重试:对非原生调用增加JSON格式约束和正则校验,参数不对时让模型重试(最多两次)。第三,容错兜底:将所有工具调用封装统一函数,捕获异常后返回结构化错误信息(如Error: 超时)喂回模型,让模型自主决定重试、换工具或降级-52。

踩分点:① 结构化调用;② 校验+重试;③ 错误反馈闭环。

Q4:什么是多智能体协作?

标准回答:多智能体系统(Multi-Agent System)是指多个具备不同角色和专业技能的Agent协同完成复杂任务-。例如:程序员Agent写代码 → 审查员Agent代码审查 → 测试Agent自动化测试。每个Agent的System Prompt限定职责和输出格式,通过顺序链或A2A(Agent-to-Agent,智能体间通信协议)协议协作-52。根据智源研究院2026年趋势,MCP、A2A等通信协议正趋于标准化,多智能体将成为Agent时代的“TCP/IP”-82。

踩分点:① 定义多智能体协作;② 举例说明分工;③ 点出标准化协议趋势。

八、结尾总结

回顾全文核心知识点:

✅ AI Agent ≠ AI助手:助手被动响应,Agent自主执行;Agent = LLM + 规划 + 记忆 + 工具

✅ 核心工作流:感知 → 推理(选工具)→ 执行 → 观察 → 再推理(ReAct循环)

✅ 底层依赖:Function Call、ReAct框架、记忆管理、工具抽象层

✅ 面试重点:LLM与Agent的区别、ReAct vs Plan-and-Execute、多智能体协作

2026年最新趋势:据Gartner预测,到2026年底,预计40%的企业应用将嵌入任务特定型AI Agent-。82%的组织计划在未来一至三年内部署AI代理-61。多智能体协作正在突破单体智能的天花板-。

下篇预告:如何从零实现一个生产级AI Agent——深入LangChain、AutoGen框架实战,敬请期待。